Việc vận hành một mô hình Trí tuệ Nhân tạo (AI) mà không cần kết nối internet nghe có vẻ đầy hứa hẹn, nhưng thông thường điều này đòi hỏi phần cứng mạnh mẽ và đắt tiền. Tuy nhiên, không phải lúc nào cũng vậy: mô hình DeepSeek R1 lại là một lựa chọn hữu ích cho các thiết bị có cấu hình thấp hơn và đặc biệt, quá trình cài đặt lại vô cùng đơn giản. Bài viết này sẽ hướng dẫn chi tiết cách bạn có thể chạy AI offline ngay trên chiếc laptop của mình với DeepSeek-R1, mang lại trải nghiệm AI cục bộ đầy tiện ích.

Chạy AI Chatbot Cục Bộ Nghĩa Là Gì?

Khi bạn sử dụng các chatbot AI trực tuyến như ChatGPT, mọi yêu cầu của bạn đều được xử lý trên các máy chủ của nhà cung cấp (ví dụ: OpenAI), nghĩa là thiết bị của bạn không phải chịu tải nặng. Điều này đòi hỏi bạn phải có kết nối internet liên tục để giao tiếp với AI, và quan trọng hơn, bạn không bao giờ có toàn quyền kiểm soát dữ liệu của mình. Các mô hình ngôn ngữ lớn (LLM) làm nền tảng cho các chatbot AI như ChatGPT, Gemini hay Claude cực kỳ tốn tài nguyên để vận hành, vì chúng phụ thuộc vào GPU với lượng VRAM khổng lồ. Đó là lý do tại sao hầu hết các mô hình AI hiện nay đều hoạt động trên nền tảng đám mây.

Một chatbot AI cục bộ (local AI chatbot) là một mô hình được cài đặt trực tiếp trên thiết bị của bạn, tương tự như bất kỳ phần mềm nào khác. Điều này đồng nghĩa với việc bạn không cần kết nối internet liên tục để sử dụng chatbot AI và có thể gửi yêu cầu bất cứ lúc nào. DeepSeek-R1 là một LLM cục bộ có thể cài đặt trên nhiều thiết bị. Mô hình 7B (bảy tỷ tham số) đã được chắt lọc và tối ưu của DeepSeek-R1 hoạt động tốt trên các phần cứng tầm trung, cho phép bạn tạo ra phản hồi AI mà không cần thông qua xử lý đám mây. Nói một cách đơn giản, điều này mang lại tốc độ phản hồi nhanh hơn, quyền riêng tư tốt hơn và toàn quyền kiểm soát dữ liệu cá nhân.

Hướng Dẫn Cài Đặt DeepSeek-R1 Trên Laptop Cá Nhân

Chạy DeepSeek-R1 trên thiết bị của bạn khá đơn giản, nhưng hãy lưu ý rằng bạn đang sử dụng phiên bản ít mạnh mẽ hơn so với chatbot AI dựa trên web của DeepSeek. Chatbot AI trực tuyến của DeepSeek sử dụng khoảng 671 tỷ tham số, trong khi DeepSeek-R1 bản chạy cục bộ chỉ có khoảng 7 tỷ tham số.

Bạn có thể tải xuống và sử dụng DeepSeek-R1 trên máy tính của mình bằng cách làm theo các bước sau:

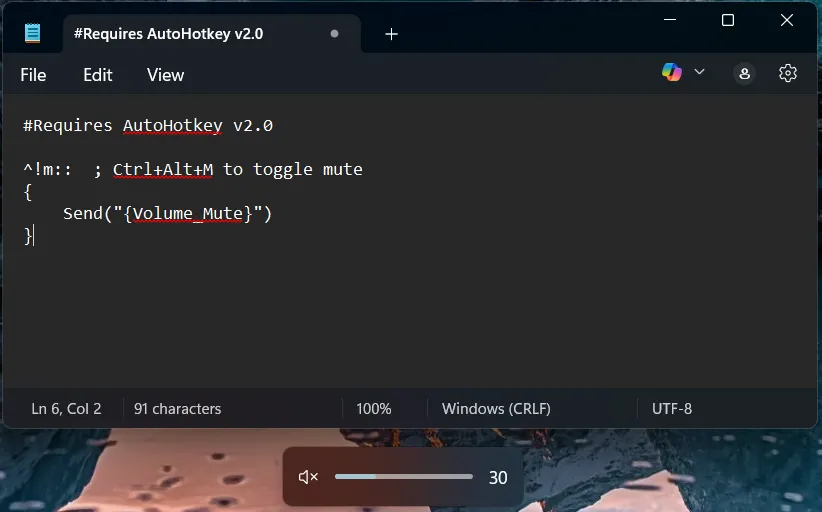

- Truy cập trang web của Ollama và tải xuống phiên bản mới nhất. Sau đó, cài đặt nó trên thiết bị của bạn như bất kỳ ứng dụng nào khác.

- Mở Terminal (hoặc Command Prompt/PowerShell trên Windows), và nhập lệnh sau:

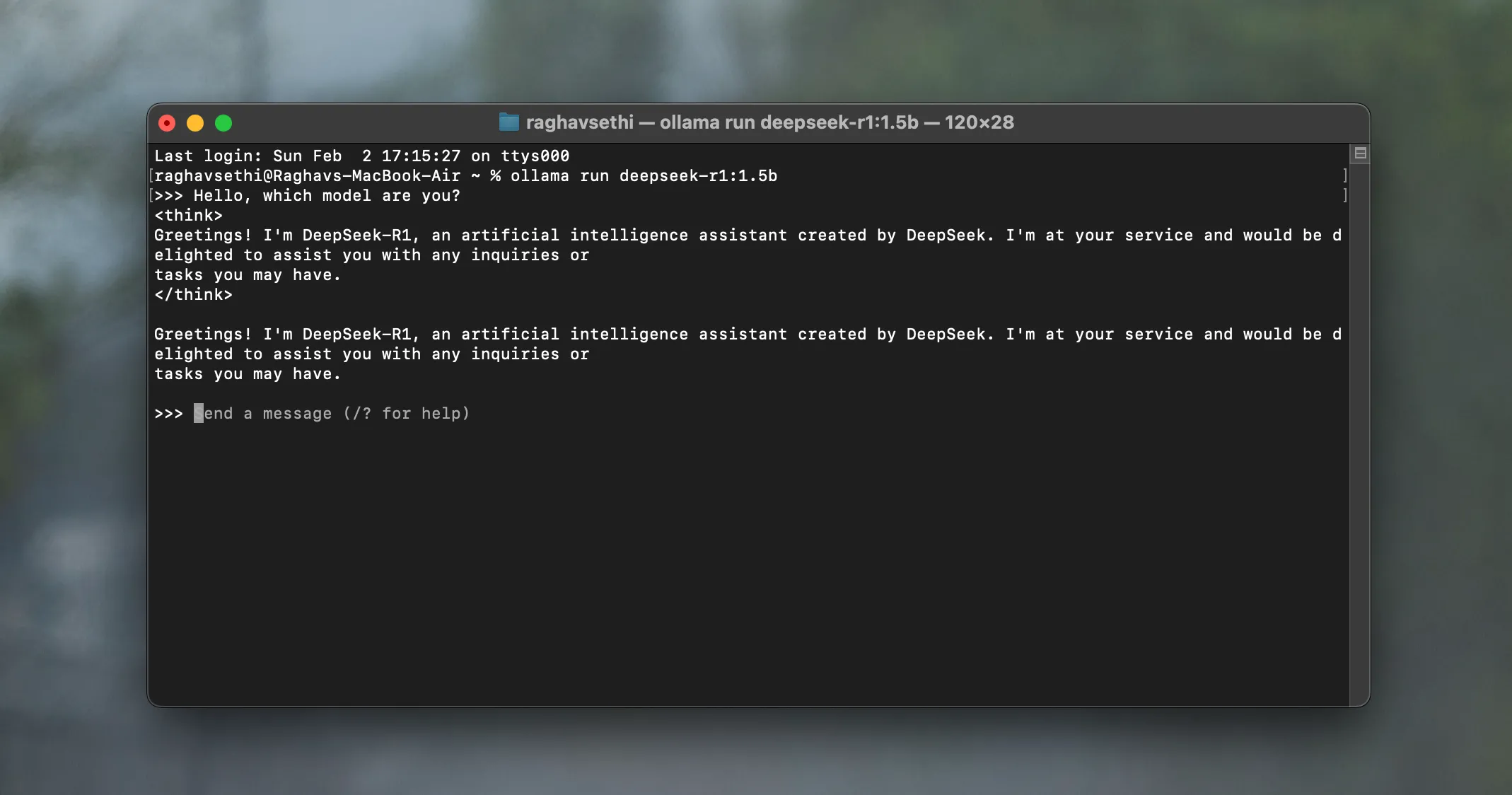

ollama run deepseek-r1:7b DeepSeek-R1 chạy trong cửa sổ Terminal

DeepSeek-R1 chạy trong cửa sổ Terminal

Lệnh này sẽ tải mô hình DeepSeek-R1 phiên bản 7B xuống máy tính của bạn, cho phép bạn nhập các truy vấn vào Terminal và nhận phản hồi. Nếu bạn gặp vấn đề về hiệu suất hoặc ứng dụng bị treo, hãy thử sử dụng mô hình ít tốn tài nguyên hơn bằng cách thay thế 7b bằng 1.5b trong lệnh trên.

Mặc dù mô hình hoạt động hoàn hảo trong Terminal, nhưng nếu bạn muốn một giao diện người dùng đầy đủ tính năng với định dạng văn bản chuẩn như ChatGPT, bạn cũng có thể sử dụng các ứng dụng như Chatbox.

Trải Nghiệm Thực Tế Khi Chạy DeepSeek Cục Bộ: Ưu Nhược Điểm

Như đã đề cập trước đó, các phản hồi từ mô hình DeepSeek-R1 offline sẽ không tốt (hoặc nhanh!) bằng những phản hồi từ chatbot AI trực tuyến của DeepSeek, vì bản trực tuyến sử dụng một mô hình mạnh mẽ hơn và xử lý mọi thứ trên đám mây. Nhưng hãy cùng xem các mô hình nhỏ hơn này hoạt động tốt đến mức nào trong các tác vụ cụ thể.

Giải Quyết Các Bài Toán Phức Tạp

Để kiểm tra hiệu suất của mô hình tham số 7B, tôi đã đưa cho nó một phương trình và yêu cầu nó giải tích phân. Tôi khá hài lòng với cách nó hoạt động, đặc biệt là vì các mô hình cơ bản thường gặp khó khăn với toán học.

Tôi phải thừa nhận đây không phải là câu hỏi phức tạp nhất, nhưng đó chính là lý do tại sao việc chạy LLM cục bộ lại hữu ích đến vậy. Nó giúp bạn có một công cụ luôn sẵn sàng để xử lý các truy vấn đơn giản ngay tại chỗ, thay vì phải phụ thuộc vào đám mây cho mọi thứ.

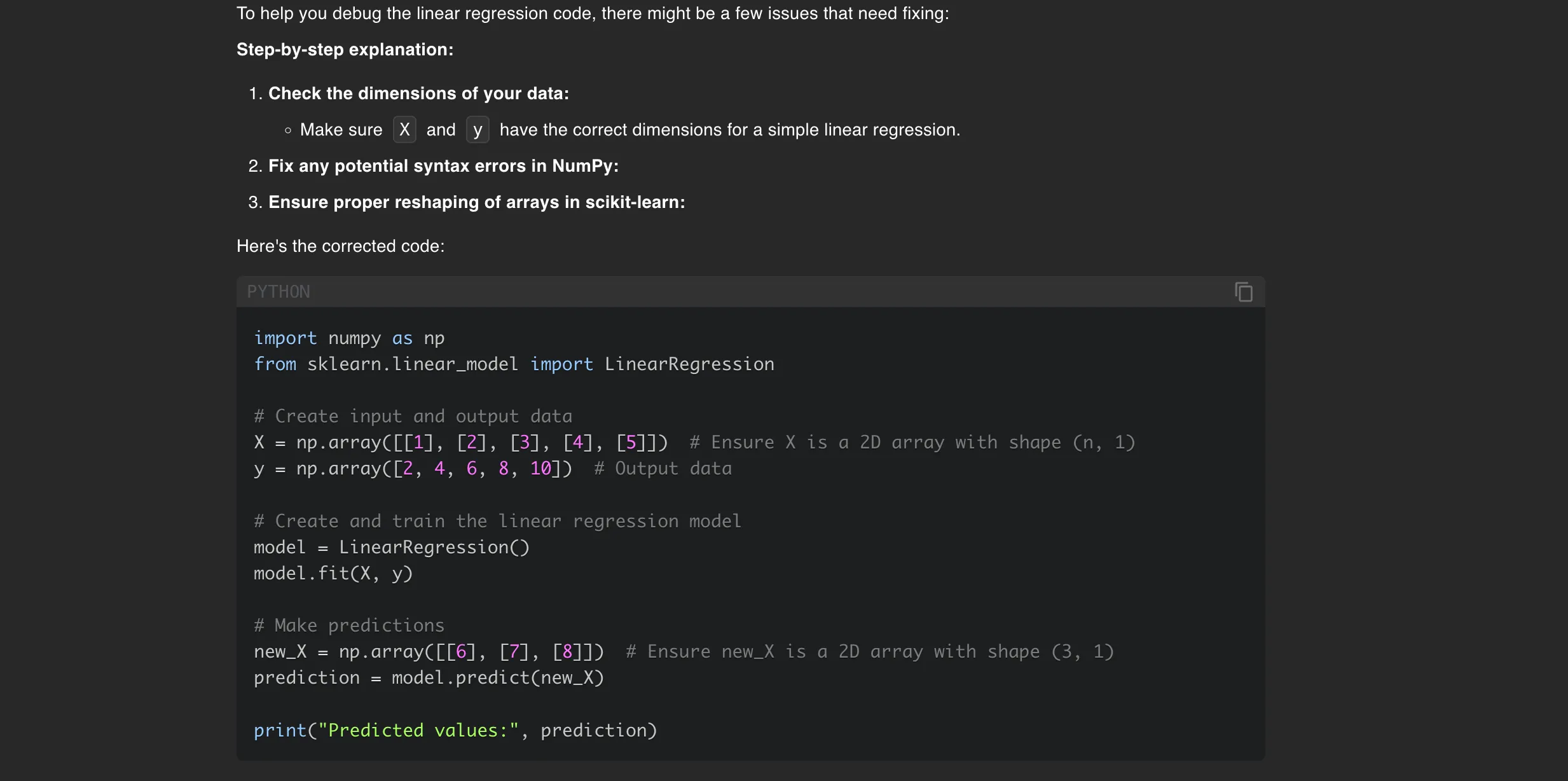

Hỗ Trợ Gỡ Lỗi (Debug) Code Hiệu Quả

Một trong những công dụng tốt nhất mà tôi nhận thấy khi chạy DeepSeek-R1 cục bộ là khả năng hỗ trợ các dự án AI của mình. Nó đặc biệt hữu ích vì tôi thường viết code trên các chuyến bay khi không có kết nối internet, và tôi phụ thuộc rất nhiều vào LLM để gỡ lỗi. Để kiểm tra mức độ hiệu quả của nó, tôi đã cung cấp đoạn code này với một lỗi ngớ ngẩn được cố tình thêm vào:

X = np.<span>array</span>([<span>1</span>, <span>2</span>, <span>3</span>, <span>4</span>, <span>5</span>]).reshape(<span>-1</span>, <span>1</span>) y = np.<span>array</span>([<span>2</span>, <span>4</span>, <span>6</span>, <span>8</span>, <span>10</span>]) <p>model = LinearRegression() <span>model</span><span>.fit</span>(<span>X</span>, <span>y</span>) </p><p>new_X = np.<span>array</span>([<span>6</span>, <span>7</span>, <span>8</span>]) prediction = model.predict(new_X)</p>Nó xử lý đoạn code này một cách dễ dàng. Tuy nhiên, cần lưu ý rằng tôi đang chạy thử nghiệm này trên một chiếc MacBook Air M1 với chỉ 8GB Unified Memory (Bộ nhớ hợp nhất được chia sẻ giữa CPU, GPU và các bộ phận khác của SoC).

DeepSeek-R1 sửa lỗi mã Python

DeepSeek-R1 sửa lỗi mã Python

Với một môi trường phát triển tích hợp (IDE) đang mở và nhiều tab trình duyệt đang chạy, hiệu suất của MacBook đã bị ảnh hưởng nghiêm trọng – tôi đã phải buộc đóng mọi thứ để máy tính phản hồi trở lại. Nếu bạn có 16GB RAM hoặc thậm chí là một GPU tầm trung, bạn có thể sẽ không gặp phải những vấn đề này.

Tôi cũng đã thử nghiệm nó với các codebase lớn hơn, nhưng nó bị kẹt trong một vòng lặp suy nghĩ, vì vậy tôi sẽ không hoàn toàn dựa vào nó để thay thế các mô hình mạnh mẽ hơn. Mặc dù vậy, nó vẫn hữu ích cho việc tạo nhanh các đoạn code nhỏ.

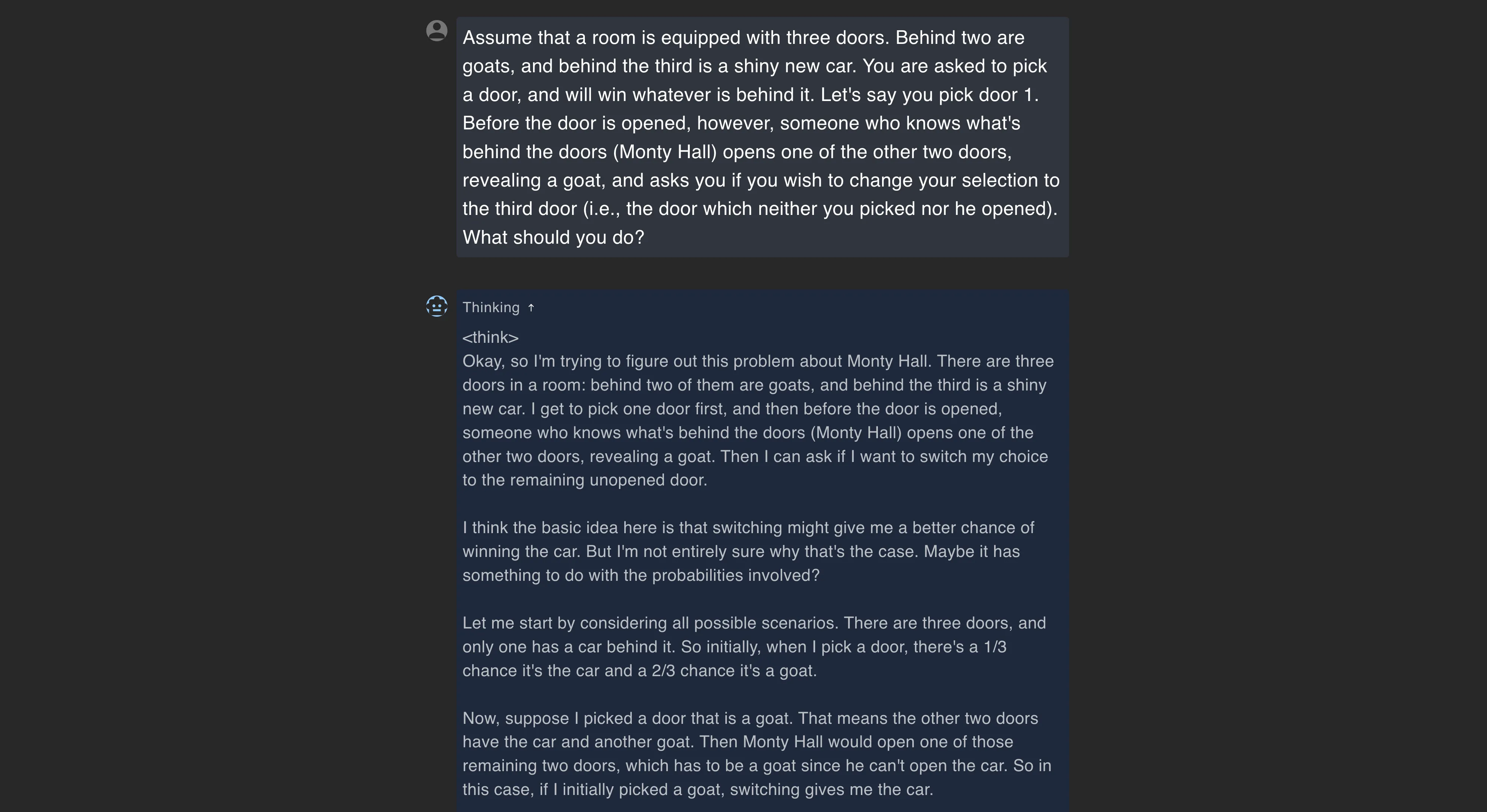

Khả Năng Giải Quyết Các Câu Đố Logic

Tôi cũng tò mò muốn xem mô hình xử lý các câu đố và lý luận logic tốt đến mức nào, vì vậy tôi đã thử nghiệm nó với bài toán Monty Hall, và nó đã dễ dàng giải quyết được. Nhưng tôi thực sự bắt đầu đánh giá cao DeepSeek vì một lý do khác.

DeepSeek-R1 giải quyết vấn đề Monty Hall

DeepSeek-R1 giải quyết vấn đề Monty Hall

Như hình ảnh hiển thị, nó không chỉ đưa ra câu trả lời mà còn hướng dẫn bạn qua toàn bộ quá trình suy nghĩ, giải thích cách nó đi đến giải pháp. Điều này làm rõ rằng nó đang lý luận thông qua vấn đề chứ không chỉ đơn thuần là gợi lại một câu trả lời đã ghi nhớ từ dữ liệu huấn luyện của nó.

Hạn Chế Khi Làm Việc Nghiên Cứu và Cập Nhật Thông Tin

Một trong những nhược điểm lớn nhất của việc chạy LLM cục bộ là giới hạn về dữ liệu kiến thức của nó. Vì nó không thể truy cập internet, việc tìm kiếm thông tin đáng tin cậy về các sự kiện gần đây có thể là một thách thức. Hạn chế này đã rõ ràng trong quá trình thử nghiệm của tôi, và thậm chí còn tệ hơn khi tôi yêu cầu nó cung cấp một cái nhìn tổng quan ngắn gọn về chiếc iPhone đầu tiên – nó đã tạo ra một phản hồi không chính xác và vô cùng hài hóm.

Chiếc iPhone đầu tiên rõ ràng không ra mắt với iOS 5, cũng không phải sau một “iPhone 3” không tồn tại. Nó đã sai gần như mọi thứ. Tôi đã thử nghiệm nó với một vài câu hỏi cơ bản khác, nhưng các lỗi không chính xác vẫn tiếp diễn.

DeepSeek Cục Bộ: Giải Pháp Tối Ưu Cho Quyền Riêng Tư và Hiệu Quả Offline

Sau khi DeepSeek gặp phải sự cố rò rỉ dữ liệu, việc có thể chạy mô hình AI cục bộ này mà không phải lo lắng về việc dữ liệu của mình bị lộ ra ngoài đã mang lại cảm giác an tâm. Mặc dù nó không hoàn hảo, việc có một trợ lý AI ngoại tuyến là một lợi thế rất lớn. Tôi mong muốn thấy nhiều mô hình như thế này được tích hợp vào các thiết bị tiêu dùng như điện thoại thông minh, đặc biệt là sau những thất vọng của tôi với Apple Intelligence.

DeepSeek-R1 mang đến một giải pháp hữu ích cho những ai muốn tận dụng sức mạnh của AI mà không cần phụ thuộc vào internet hay lo lắng về quyền riêng tư. Dù không thể thay thế hoàn toàn các mô hình đám mây mạnh mẽ cho mọi tác vụ, nó vẫn là công cụ đáng giá cho các nhu cầu hàng ngày, đặc biệt là trong các tình huống không có kết nối mạng.

Bạn nghĩ sao về khả năng chạy AI cục bộ? Hãy chia sẻ ý kiến của bạn về DeepSeek-R1 và các giải pháp AI offline khác tại phần bình luận bên dưới nhé!